에이전트 도구를 실제 ML 업무에 붙여 보면 금방 드러나는 한계가 있다. 논문 요약이나 코드 초안 생성은 그럭저럭 되지만, 데이터셋 탐색, GitHub 코드 검색, 로컬 추론 서버 사용, 장시간 세션 기록, 민감한 실행에 대한 승인, 사후 추적까지 하나의 작업 루프로 엮는 단계에서 갑자기 허술해지는 경우가 많다.

huggingface/ml-intern이 눈에 띄는 이유는 바로 이 끊어진 구간을 정면으로 제품화하려 하기 때문이다. README 첫 문장은 이 프로젝트를 “논문을 읽고, 모델을 학습하고, ML 관련 코드를 작성하고, Hugging Face 생태계를 깊게 활용하는 오픈소스 ML intern”으로 소개한다. 하지만 저장소 구조, 설정 파일, Space 표면, 최근 커밋, CLI/웹 분리 구조까지 같이 보면 실체는 더 구체적이다. 이 프로젝트는 단순한 연구 보조 챗봇보다 Hugging Face 중심의 ML 작업을 계속 굴리기 위한 운영형 에이전트 런타임에 가깝다.

특히 중요한 점은 이 저장소가 모델 호출 자체보다 작업 표면의 연결성에 더 많은 설계 에너지를 쓰고 있다는 것이다. HF_TOKEN, GITHUB_TOKEN, 로컬 OpenAI-compatible endpoint, Slack 알림, Hub trace 업로드, MCP 서버 연결이 모두 한 프로젝트 안에 같이 들어 있다. 즉 “모델이 대답을 잘하느냐”보다 “ML 팀의 실제 작업 흐름을 얼마나 중단 없이 이어 갈 수 있느냐”가 이 저장소의 진짜 경쟁축으로 보인다.

무엇을 해결하려는가

이 프로젝트가 겨냥하는 문제는 “코드를 잘 써 주는 AI”보다 조금 더 넓다. ML 팀의 일은 보통 논문 검토, 데이터셋 조사, Hub 자산 확인, GitHub 저장소 탐색, 실험 코드 수정, 샌드박스 실행, 실패 분석, 결과 공유까지 여러 표면을 왕복한다. 그런데 대부분의 에이전트 도구는 이 중 일부만 잘한다.

ml-intern은 이 분절을 줄이려는 시도다. README 기준 사용자는 interactive mode로 대화형 세션을 열 수도 있고, headless mode로 단일 프롬프트를 배치형으로 실행할 수도 있다. 모델도 Claude, GPT, HF Router 계열, Ollama, vLLM, LM Studio, llama.cpp 같은 OpenAI-compatible 경로를 함께 상정한다. 즉 처음부터 특정 모델 데모가 아니라 여러 공급자와 여러 실행 표면을 묶는 작업용 인터페이스를 목표로 한다.

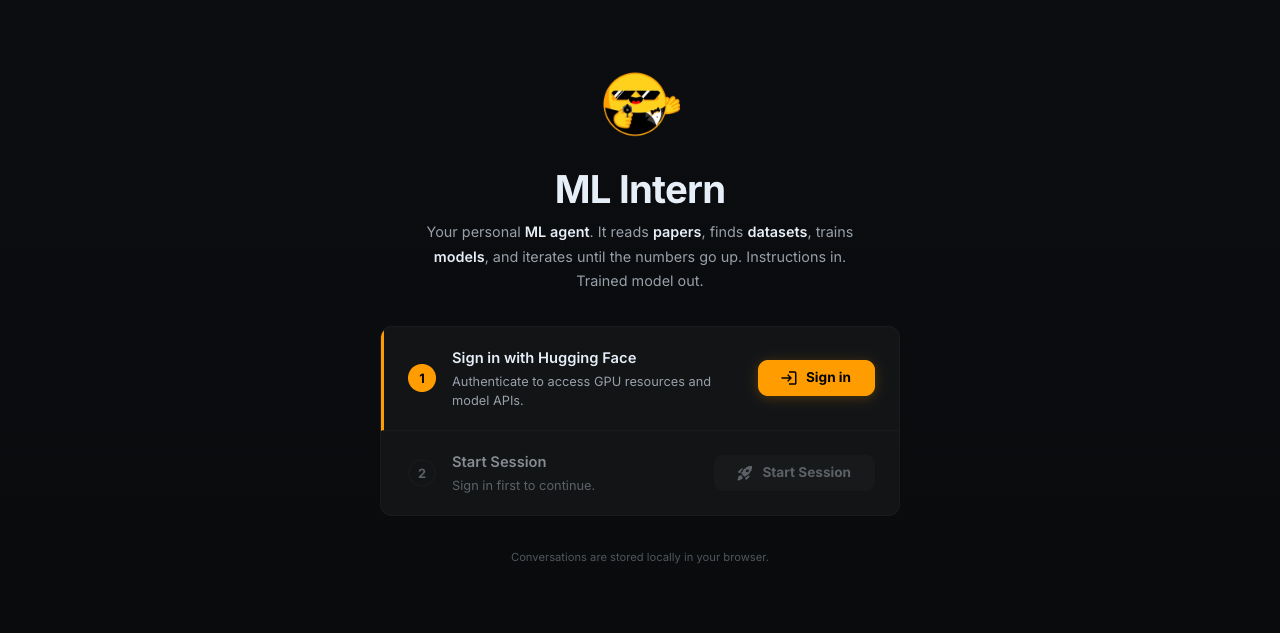

실제 제품 표면도 그 방향과 맞아 있다. 공식 Space는 로그인 전부터 Hugging Face 인증과 세션 시작을 단계형으로 보여 주고, 로컬 개발 메모인 AGENTS.md는 프런트엔드 Vite 서버, FastAPI 백엔드, HF OAuth scope, Space 배포 브랜치 운영까지 분리해서 다룬다. 이건 단순 샘플 앱보다 상시 운영을 염두에 둔 OSS 제품에 더 가까운 흔적이다.

핵심 아이디어 / 구조 / 동작 방식

저장소의 핵심은 한 개의 “똑똑한 에이전트”보다 비동기 작업 루프와 도구 라우팅 구조에 있다. 루트 pyproject.toml은 CLI 엔트리포인트를 ml-intern = "agent.main:cli"로 노출하고, 패키지 데이터로 configs/*.json과 agent/prompts/*.yaml까지 함께 배포한다. 주석을 보면 설정 파일이나 시스템 프롬프트가 빠지면 설치는 되더라도 런타임이 깨질 수 있어서, 애초에 패키징 단계에서 이를 방지하려는 의도가 드러난다.

README의 아키텍처 섹션도 꽤 직접적이다. submission_queue → submission_loop → Handlers.run_agent() → Session / ContextManager / ToolRouter → event_queue 흐름을 공개하고, 그 안에 approval check, doom loop detector, session upload를 명시한다. 다시 말해 이 저장소는 모델 호출을 감싼 얇은 래퍼가 아니라, 큐 기반 세션 실행기 + 컨텍스트 관리자 + 툴 실행 허브 + 이벤트 스트림으로 자신을 설명한다.

루트 의존성도 같은 그림을 뒷받침한다. litellm, huggingface-hub, fastmcp, fastapi, uvicorn, websockets, apscheduler, pymongo, whoosh, nbconvert가 한데 묶여 있다. 여기에 프런트엔드 package.json은 React, Vite, MUI, @ai-sdk/react, react-markdown, zustand를 사용한다. 즉 CLI만 있는 도구가 아니라 대화형 런타임, 웹 표면, 백그라운드 작업, 추적·검색 기능을 모두 한 제품 안에 넣는 쪽으로 설계돼 있다.

| 레이어 | 공개 자료에서 확인되는 구성 | 의미 |

|---|---|---|

| Agent runtime | agent.main:cli, submission_loop, Session, ContextManager, ToolRouter |

단순 단발 호출이 아니라 세션형 작업 루프 중심 |

| Model access | LiteLLM + Claude/GPT/HF Router/Ollama/vLLM/LM Studio/llama.cpp 지원 | 특정 공급자 고정이 아닌 멀티 모델 운영 표면 |

| Product surface | FastAPI 백엔드, React/Vite 프런트엔드, HF Space 로그인 화면 | CLI 실험을 넘어 웹 사용성과 배포까지 고려 |

| Tooling & extension | Hugging Face Hub, GitHub, MCP 서버, 로컬 도구, 샌드박스 | ML 작업에 필요한 외부 표면을 런타임 안으로 편입 |

| Ops controls | approval check, doom loop detector, event queue, Slack notifications | 장시간 실행과 실패 제어를 운영 문제로 취급 |

특히 configs/cli_agent_config.json이 흥미롭다. 기본 모델은 anthropic/claude-opus-4-6, share_traces는 기본 활성화, personal_trace_repo_template는 {hf_user}/ml-intern-sessions, 그리고 MCP 서버는 https://huggingface.co/mcp?login으로 잡혀 있다. 이 설정은 프로젝트가 처음부터 Hugging Face 내부 자산과 외부 도구 연결을 기본값으로 간주한다는 점을 보여 준다.

공개된 근거에서 확인되는 점

가장 눈에 띄는 기능은 Sharing Traces다. README는 모든 세션을 사용자 자신의 private Hugging Face dataset에 Claude Code JSONL 형식으로 자동 업로드한다고 설명한다. 기본 이름은 {your-hf-username}/ml-intern-sessions이고, /share-traces public 또는 /share-traces private로 공개 범위를 바꿀 수 있다.

이 선택은 단순 로그 저장과 다르다. 많은 에이전트 도구가 세션을 로컬 파일이나 SaaS 대시보드에 가두는 반면, ml-intern은 세션 기록을 Hub-native artifact로 승격시킨다. 추론 과정과 툴 호출 이력이 나중에 재검토 가능한 자산이 된다는 뜻이다. ML 작업에서는 최종 답변보다도 “어떤 도구를 어떤 순서로 불렀고 어디서 실패했는가”가 더 중요할 때가 많은데, 이 프로젝트는 그 포인트를 비교적 정확히 짚는다.

Supported Gateways와 Space 운영 메모도 같은 방향을 가리킨다. Slack 통합은 approval_required, error, turn_complete 같은 이벤트를 외부 채널로 보내고, 아키텍처 다이어그램에는 jobs, sandbox, destructive ops에 대한 approval check가 별도 단계로 들어 있다. 완전 자동화만 강조하는 대신 사람 승인과 상태 통지까지 포함한 운영 루프를 기본 개념에 넣은 셈이다.

패키징 신호도 나쁘지 않다. GitHub API 기준 저장소는 2025-10-30 생성, 기본 브랜치는 main, 언어는 Python, 라이선스는 Apache-2.0이다. 조회 시점 기준 별은 약 9.1k, 포크는 936개다. 최근 커밋은 Use hyphenated ml-intern Trackio prefixes, Use duplicate_repo for sandbox Spaces, Fix stale tool error badges, Fix GPU sandbox hardware OAuth failure처럼 제품 운영과 배포 이슈에 가깝다. 단순 컨셉 저장소보다 실제 사용자 플로우를 다듬는 단계에 더 가까워 보인다.

반면 버저닝 측면은 아직 덜 정돈돼 있다. 루트 pyproject.toml에는 version = "0.1.0"이 있지만, GitHub tags는 비어 있고 releases/latest는 404를 반환한다. 즉 설치 가능한 패키지 형태와 코드베이스는 갖추고 있지만, 외부 팀 입장에서는 안정 릴리스 채널보다는 메인 브랜치 중심 진화로 읽힐 여지가 있다.

| 공개 근거 | 확인된 내용 | 해석 |

|---|---|---|

README Sharing Traces |

세션을 개인 HF dataset으로 자동 업로드, 기본 private | observability를 Hugging Face 자산 위에 올리는 설계 |

README Supported Gateways |

Slack으로 approval/error/turn_complete 알림 전송 | 사람 승인과 비동기 통지를 작업 루프에 통합 |

configs/cli_agent_config.json |

기본 trace 공유 켜짐, HF MCP 서버 등록 | Hugging Face 생태계 연결이 부가 기능이 아니라 기본값 |

pyproject.toml |

CLI 엔트리포인트, config/prompt 파일을 패키지 데이터로 포함 | 설치형 도구로 배포하려는 의도가 분명함 |

| GitHub API / 최근 커밋 | 9.1k stars, 936 forks, 최근 커밋이 OAuth·UI·sandbox 이슈 중심 | 데모보다 운영면 polish가 계속 진행 중 |

| Tags / Releases | tags 0개, releases/latest 404, 루트 버전은 0.1.0 | 빠른 메인 브랜치 진화에 비해 릴리스 discipline은 아직 약함 |

실무 관점에서의 해석

내가 보기에 ml-intern의 진짜 차별점은 “ML 질문에 답하는 모델”이 아니라 Hugging Face를 중심으로 한 ML 업무 전체를 에이전트가 오갈 수 있는 표면으로 재구성한다는 데 있다. 논문, 데이터셋, 모델, GitHub 코드, 로컬 추론 서버, 세션 트레이스, 승인 이벤트가 모두 흩어져 있지 않고 하나의 실행 루프 안에 들어온다는 점이 핵심이다.

이런 구조는 실제 팀에서 꽤 중요하다. 예를 들어 새로운 파인튜닝 아이디어를 검토할 때도 논문 읽기, 데이터셋 확인, 기존 레포 검색, 샌드박스 실행, 로그 재검토, 실패 원인 공유가 이어진다. 대부분의 툴은 이 중 한두 단계만 잘하지만, ml-intern은 적어도 공개 구조상으로는 그 전체 연결면을 제품의 중심에 둔다.

장점은 분명하다.

- Hub와 GitHub를 같이 다루는 ML 팀 workflow에 잘 맞는다.

- 세션 기록을 dataset으로 남겨 나중에 재현·분석하기 쉽다.

- 멀티 모델과 로컬 endpoint를 함께 수용해 환경 유연성이 높다.

- 승인 흐름과 이벤트 스트림이 있어 장시간 작업 제어에 유리하다.

하지만 비용도 있다.

HF_TOKEN,GITHUB_TOKEN, 선택적 모델 provider key, 로컬 endpoint까지 준비해야 해서 온보딩이 가볍지 않다.- CLI, backend, frontend, trace, OAuth, sandbox가 얽혀 있어 운영 복잡도가 높다.

- 릴리스 태그가 없는 상태에서는 외부 팀이 안정 버전을 고정하기 다소 까다롭다.

그래도 방향성은 설득력이 있다. 최근 많은 에이전트 제품이 결국 좋은 채팅 UI에서 멈추는 반면, ml-intern은 실행·기록·승인·생태계 연결을 함께 다루는 ML workbench runtime 쪽으로 가고 있다. 만약 앞으로 Hugging Face 안에서 돌아가는 오픈소스 ML 에이전트가 더 성숙해진다면, 이런 구조가 표준 형태 중 하나가 될 가능성은 충분하다.

한 줄로 요약하면

huggingface/ml-intern은 단순히 ML 관련 질문에 답하는 조수라기보다, Hugging Face Hub·GitHub·로컬 모델 서버·세션 트레이스·승인 이벤트를 한 루프에 묶어 ML 엔지니어링 작업을 계속 이어 가게 만드는 운영형 에이전트 런타임으로 보는 편이 더 정확하다.